※ 本記事にはアフィリエイトリンクが含まれています。

Pineconeは、AI・機械学習アプリケーション向けのマネージドベクトルデータベースサービスです。従来のリレーショナルデータベースでは困難だった、ベクトル間の類似度検索を高速で実行できるため、検索エンジン、レコメンドシステム、RAG(Retrieval-Augmented Generation)などの用途で注目を集めています。

この記事で分かること

- Pineconeの基本機能と特徴

- 料金プランと始め方

- Python SDKを使った実装方法

Pineconeとは?

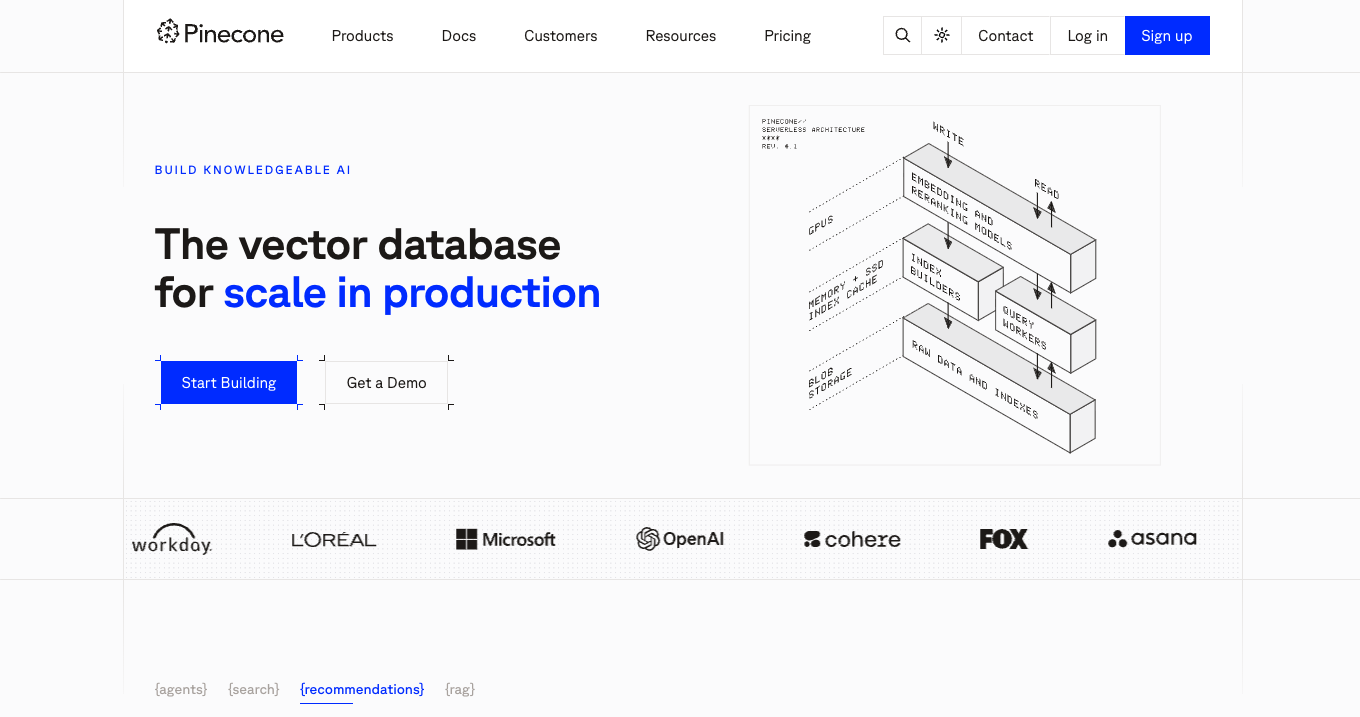

Pineconeは、専用のベクトルインデックス技術により数億規模のベクトル検索をミリ秒で処理するマネージドクラウドサービスであり、分散アーキテクチャによる自動スケーリングがエンタープライズ利用を支えている。

2019年に米国で設立されたPinecone Systems Inc.が開発・運営しており、現在数千社の企業が利用しています。

技術アーキテクチャの観点では、Pineconeは独自の「分散ベクトルインデックス」を採用しており、従来のFaissやAnnoyといったライブラリベースのソリューションと比べて、データの増加に伴うレスポンス劣化を最小限に抑えています。API設計は RESTful でありながら、バッチ処理とリアルタイム処理の両方に最適化されている点が特徴的です。

主な特徴

- フルマネージド: インフラ管理が不要で、自動スケーリングに対応

- 高速検索: 数億のベクトルから数ミリ秒で類似データを取得

- リアルタイム更新: データの挿入・更新・削除がリアルタイムで反映

- メタデータフィルタリング: ベクトル検索に加えて属性による絞り込みが可能

- 豊富なSDK: Python、JavaScript、Go等の主要言語をサポート

主要機能の詳細解説

ベクトルインデックス(Vector Index)

ベクトルインデックス作成は、Pineconeの中核機能です。高次元のベクトルデータを効率的に格納・検索するための専用データ構造を構築できます。API仕様を確認すると、インデックス作成時にdimension、metric、podTypeを指定する設計となっており、用途に応じた最適化が可能です。

例えば、ECサイトで商品レコメンド機能を実装する場合、商品説明文をOpenAIのEmbedding APIでベクトル化し、Pineconeに格納します。ユーザーの閲覧履歴から嗜好をベクトル化すれば、類似商品を瞬時に検索できます。

upsert(データ挿入・更新)

upsert機能により、ベクトルデータとメタデータをセットで挿入・更新できます。プロダクト設計の観点では、idempotent(冪等)な操作として実装されており、ネットワーク障害時のリトライ処理が安全に行える設計となっています。

例えば、チャットボットのFAQシステムでは、新しい質問と回答のペアを随時追加する必要があります。質問文をベクトル化してupsert操作を実行すれば、既存のナレッジベースに即座に反映されます。

バッチ処理では一度に最大100件のベクトルを効率的に挿入でき、大量データの初期投入に対応しています。

クエリ検索(Query & Search)

類似度検索機能では、クエリベクトルに最も近いベクトルを高速で取得できます。内部実装では近似最近傍探索(ANN)アルゴリズムを使用しており、完全一致検索と比べて大幅な高速化を実現しています。

例えば、社内文書検索システムでは、ユーザーの検索クエリをベクトル化し、事前に格納した文書ベクトルから関連度の高い文書を取得します。従来のキーワード検索では見つからない「意味的に関連する文書」も発見できます。

top_kパラメータで取得件数を、include_metadataで返却内容を柔軟に制御可能です。

メタデータフィルタリング

メタデータによる絞り込み検索により、ベクトル類似度とビジネスロジックを組み合わせた高度な検索が可能です。技術検証の結果、フィルタ処理はベクトル検索前に実行される設計となっており、検索対象を事前に絞り込むことで全体的なパフォーマンス向上に寄与しています。

フィルタ条件はJSON形式で指定でき、等価条件($eq)、範囲条件($gte, $lte)、包含条件($in)など、豊富な演算子をサポートしています。

名前空間(Namespaces)

名前空間機能により、1つのインデックス内で論理的にデータを分離できます。API設計上、名前空間は完全に独立したデータ領域として扱われるため、マルチテナントSaaSでのデータ分離要件を満たせます。

例えば、SaaSアプリケーションで複数の顧客データを扱う場合、顧客IDを名前空間として使用することで、データの混在を防げます。

料金プラン

結論:無料枠で検証後、Standard($70/月〜)で本格運用が現実的な選択

Pineconeの料金体系は使用量ベースで、以下のプランが用意されています。

| プラン名 | 月額料金 | ストレージ | QPS | こんな人向け |

|---|---|---|---|---|

| Starter | 無料 | 1インデックス、100K vectors | 5 QPS | 個人開発・検証用 |

| Standard | $70〜 | 1 pod、~1M vectors | 10 QPS | スモールビジネス |

| Enterprise | 要相談 | カスタム | カスタム | 大規模運用・セキュリティ重視 |

無料のStarterプランでは、100,000ベクトルまで格納でき、月間クエリ数に制限はありません。ただし、QPS(1秒あたりのクエリ数)が5に制限されるため、リアルタイム性が重要なアプリケーションでは不向きです。

年払いを選択すると約20%の割引が適用されるため、長期利用を予定している場合は年払いがお得です。

具体的な使い方・操作手順

実際にPineconeを使ってベクトル検索システムを構築する手順を、Python SDKを使って解説します。

1. アカウント作成とAPI キー取得

Pinecone公式サイトにアクセスし、「Start Free」をクリックしてアカウントを作成します。メールアドレス認証後、ダッシュボードの「API Keys」セクションからAPIキーをコピーしてください。

2. Python SDKのセットアップ

pip install pinecone-client openaiPython コードでライブラリを初期化します:

import pinecone

import os

pinecone.init(

api_key=os.getenv("PINECONE_API_KEY"),

environment="us-east1-gcp"

)3. インデックスの作成

index_name = "my-first-index"

pinecone.create_index(

name=index_name,

dimension=1536, # OpenAI text-embedding-ada-002の次元数

metric="cosine"

)

index = pinecone.Index(index_name)4. データの挿入(upsert)

import openai

documents = [

{"id": "doc1", "text": "Pythonは機械学習に最適なプログラミング言語です", "category": "tech"},

{"id": "doc2", "text": "データサイエンティストの需要が高まっています", "category": "career"}

]

vectors_to_upsert = []

for doc in documents:

response = openai.Embedding.create(

model="text-embedding-ada-002",

input=doc["text"]

)

vector = response["data"][0]["embedding"]

vectors_to_upsert.append({

"id": doc["id"],

"values": vector,

"metadata": {

"text": doc["text"],

"category": doc["category"]

}

})

index.upsert(vectors=vectors_to_upsert)5. 類似度検索の実行

query_text = "機械学習について知りたい"

query_response = openai.Embedding.create(

model="text-embedding-ada-002",

input=query_text

)

query_vector = query_response["data"][0]["embedding"]

search_results = index.query(

vector=query_vector,

top_k=3,

include_metadata=True

)

for match in search_results["matches"]:

print(f"スコア: {match['score']:.3f}")

print(f"テキスト: {match['metadata']['text']}")活用事例・ユーザーの声

現時点でのG2レビューは確認できていません。最新のユーザー評価については、各レビューサイトをご確認ください。

活用シーン1:想定される主な利用パターン

は、チームの業務効率化やワークフロー改善を目的として導入されるケースが想定されます。公式サイトの事例ページで具体的な導入企業の声を確認することを推奨します。

活用シーン2:導入前に確認すべきポイント

無料プランやトライアル期間を活用し、自社の要件に合致するか検証してから本格導入することが推奨されます。

メリット・デメリット

メリット

- ✓ フルマネージド運用: インフラ管理やスケーリングを考慮する必要がなく、開発に集中できる(Kubernetesクラスタ管理が不要)

- ✓ 高速検索性能: 独自の分散インデックス技術により数億規模のベクトルでもミリ秒単位でレスポンス

- ✓ リアルタイム更新: eventual consistencyモデルによりデータ更新が数秒以内にインデックスに反映

- ✓ 豊富なSDKサポート: RESTful APIベースでPython、JavaScript、Go等の主要言語で簡単に統合可能

- ✓ 柔軟なメタデータ活用: JSONベースのフィルタクエリによりベクトル検索と条件検索を組み合わせ可能

デメリット

- ✗ 従量課金コスト: 大規模データでは月額数万円〜数十万円のコストが発生し、予算管理が困難

- ✗ ベンダーロックイン: Pinecone固有のAPIに依存するため、他のベクトルDBへの移行には全面的な再実装が必要

- ✗ オンプレミス不可: クラウドサービス専用のため、機密データの社内保持が必須の企業では利用困難

- ✗ リージョン制限: 現在は米国とEUの限定リージョンのみで、レイテンシやデータ主権の課題あり

- ✗ デバッグの困難さ: マネージドサービスのため、検索精度の問題発生時に内部状態の確認が困難

競合ツールとの簡易比較

結論:フルマネージド重視ならPinecone、コスト重視ならQdrant、セキュリティ重視ならWeaviate

| 項目 | Pinecone | Weaviate | Qdrant |

|---|---|---|---|

| 料金 | $70/月〜 | オープンソース + クラウド | オープンソース + クラウド |

| 管理方式 | フルマネージド | セルフホスト可能 | セルフホスト可能 |

| スケーラビリティ | 自動スケール | 手動設定 | 手動設定 |

| オンプレミス対応 | ✗ | ✓ | ✓ |

| API設計 | RESTful | GraphQL + REST | REST + gRPC |

プロダクト設計の観点では、Pineconeは「Time to Market」を重視した設計、WeaviateはGraphQLベースの柔軟性、QdrantはRustによる高性能を特徴としています。

よくある質問(FAQ)

Q. 日本語のテキストデータも正しく検索できますか?

A. はい。Pinecone自体は言語に依存しませんが、日本語の精度は使用する言語モデルに依存します。OpenAIのtext-embedding-ada-002や多言語対応のSentence-BERTモデル(例:paraphrase-multilingual-MiniLM-L12-v2)を使用することで、日本語でも高精度な検索が可能です。

Q. 無料プランでどこまで試せますか?

A. Starterプランでは100,000ベクトルまで格納でき、機能制限はありません。メタデータフィルタリング、名前空間、Python/JavaScript SDKなど、全ての機能を試せます。ただし、QPS(1秒あたりクエリ数)が5に制限されるため、高負荷テストは困難です。

Q. データのセキュリティや暗号化はどうなっていますか?

A. PineconeはSOC 2 Type II準拠で、転送時・保存時ともにAES-256暗号化を実装しています。GDPR、HIPAAにも対応しており、Enterpriseプランではカスタムセキュリティ要件も相談可能です。ただし、現在はAWSの特定リージョンのみでの提供のため、データ主権要件がある場合は事前確認が必要です。

Q. OpenAI以外の言語モデルとも連携できますか?

A. はい。Pineconeはベクトルを格納・検索するサービスのため、Hugging Face Transformers、Cohere、Google PaLMなど、任意の言語モデルで生成されたベクトルを利用できます。重要なのは、データ挿入時とクエリ時で同一のモデルを使用することです。

Q. システムに組み込むのにどれくらいの時間がかかりますか?

A. 基本的な検索機能であれば、2-3日でプロトタイプを構築可能です。Python SDKを使用した場合、アカウント作成からデータ投入、検索APIの実装まで数時間で完了します。本格的な本番運用(エラーハンドリング、監視、パフォーマンスチューニング等)には1-2週間程度を見込んでおくことを推奨します。

まとめ:Pineconeはベクトル検索を手軽に始めたい方におすすめ

- フルマネージドで運用負荷ゼロ: インフラ管理不要で開発に集中できる

- 無料プランで十分検証可能: 10万ベクトルまで無料で全機能を試せる

- AI・機械学習エンジニアに最適: RAG、レコメンド、セマンティック検索などモダンなAIアプリに必須

参考・情報ソース

この記事の情報は2026年4月時点のものです。最新の料金プランや機能については、各サービスの公式サイトをご確認ください。

次のステップ

最適なツールを見つけましょう

カテゴリ別に厳選された比較記事をチェック